Guía completa sobre Modelos de Lenguaje (LLM)

16/08/2024

Introducción a los Modelos de Lenguaje

En el panorama digital actual, los Modelos de Lenguaje de Gran Tamaño (LLM) han emergido como tecnologías disruptivas, redefiniendo la interacción humano-máquina y el procesamiento de información a escala. Estos modelos, impulsados por avanzadas técnicas de inteligencia artificial, están revolucionando múltiples sectores gracias a sus capacidades para comprender y generar texto de manera precisa y coherente. En esta guía técnica, profundizaremos en el funcionamiento de los LLM, sus aplicaciones innovadoras y las diferencias fundamentales entre modelos líderes como GPT, Gemini, Claude y Mistral.

¿Qué son los LLM?

Los Grandes Modelos de Lenguaje (LLM, por sus siglas en inglés) son arquitecturas avanzadas de inteligencia artificial diseñadas para interpretar, procesar y generar texto en lenguaje natural. Entrenados con enormes volúmenes de datos textuales, estos modelos capturan patrones y estructuras complejas del lenguaje humano. Entre los ejemplos más destacados se encuentran GPT (Generative Pre-trained Transformer), Gemini, Claude y Mistral, cada uno aportando capacidades únicas y específicas.

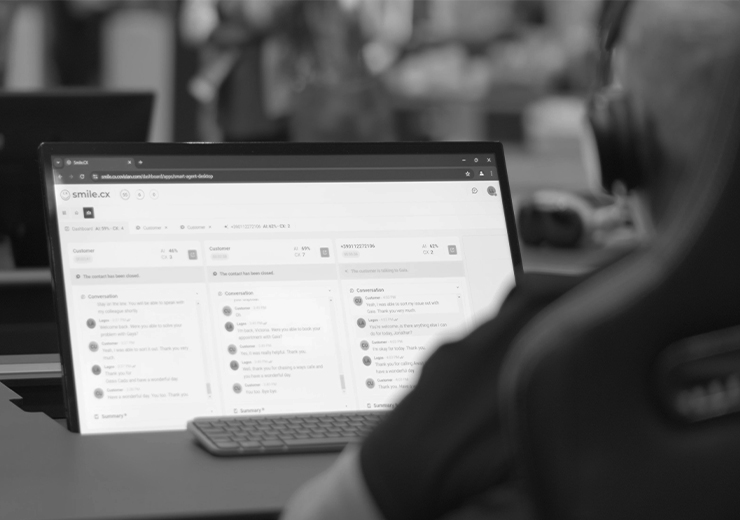

La inteligencia artificial generativa, un componente clave de los LLM, habilita la creación autónoma de contenido coherente y relevante, facilitando desde la redacción automatizada hasta interacciones personalizadas en soluciones de atención al cliente. Además, estos modelos están equipados con capacidades de aprendizaje profundo que les permiten adaptarse y mejorar continuamente, ofreciendo respuestas más precisas y contextualizadas. La integración de los LLM en diversas plataformas tecnológicas no solo optimiza los procesos empresariales, sino que también potencia la innovación en áreas como la salud, la educación y el comercio electrónico.

Modelos matemáticos que explican su funcionamiento

El núcleo de los Large Language Models se basa en complejos modelos matemáticos que permiten la comprensión y generación de lenguaje natural. La arquitectura más comúnmente utilizada es la del Transformer, la cual se fundamenta en mecanismos de atención, particularmente en el mecanismo de autoatención (self-attention). Este mecanismo asigna diferentes pesos a cada parte de la entrada, permitiendo al modelo enfocarse en las secciones más relevantes del texto y determinar qué palabras en una oración son importantes en relación con otras palabras, independientemente de la distancia entre ellas. Esto es crucial para entender contextos complejos y captar matices en el lenguaje.

La estructura del Transformer incluye capas de autoatención y capas feed-forward completamente conectadas. Las capas de autoatención permiten al modelo examinar todas las palabras de la oración simultáneamente y evaluar la importancia relativa de cada palabra. Por otro lado, las capas feed-forward procesan la información recibida de manera más profunda para generar representaciones más precisas del texto.

Una de las grandes ventajas del Transformer es su capacidad para procesar datos en paralelo. A diferencia de las redes neuronales recurrentes (RNN), que procesan la información de manera secuencial, el Transformer puede manejar todas las palabras de una oración al mismo tiempo. Esto no solo mejora la eficiencia computacional, sino que también permite al modelo capturar dependencias a largo plazo en el texto, algo que las RNN encuentran difícil debido a su naturaleza secuencial.

Los LLM como GPT también utilizan técnicas de pre entrenamiento (para aprender patrones lingüísticos generales) y ajuste fino (para adaptar a tareas específicas con datos etiquetados), lo que mejora su precisión y versatilidad en aplicaciones prácticas. Con el avance continuo en la investigación y el desarrollo de nuevas arquitecturas, los LLM siguen evolucionando, ofreciendo soluciones cada vez más sofisticadas y eficientes para la interacción humano-máquina.

Conceptos clave en los LLM

Los Grandes Modelos de Lenguaje (LLM) representan un avance significativo en la inteligencia artificial y se destacan por su capacidad para entender y generar texto humano de manera coherente y precisa. Estos modelos utilizan mecanismos avanzados de atención para captar relaciones complejas dentro del texto, permitiendo un procesamiento eficiente de largas secuencias de datos. La clave de su funcionamiento reside en el manejo de tokens, unidades mínimas de texto que son interpretadas y transformadas mediante embeddings, representaciones vectoriales que dotan de significado a cada elemento lingüístico.

Este enfoque no solo facilita la comprensión del contexto textual, sino que también habilita la generación autónoma de contenido de alta calidad. La versatilidad y el potencial transformador de los LLM están marcando el camino hacia nuevas fronteras en la interacción humano-máquina y la inteligencia artificial aplicada.

El impacto de las grandes bases de datos en los LLM

Las grandes bases de datos son fundamentales para el desarrollo de los Modelos de Lenguaje de gran escala (LLM). La calidad y la cantidad de los datos utilizados en el entrenamiento determinan la capacidad del modelo para comprender y generar texto de manera coherente y precisa. Con vastas cantidades de datos, los LLM pueden captar patrones complejos, contextos diversos y matices lingüísticos que son esenciales para aplicaciones prácticas. Sin estas enormes colecciones de datos, los LLM no podrían alcanzar los niveles de desempeño actuales, lo que subraya la importancia de acceder a fuentes de datos ricas y variadas. Además, la diversidad de las bases de datos ayuda a los LLM a ser más inclusivos y menos propensos a sesgos, mejorando su aplicabilidad en diferentes contextos culturales y lingüísticos.

Qué son los Transformers y los tokens

Los Transformers son una arquitectura de red neuronal que ha revolucionado el procesamiento del lenguaje natural. Utilizan mecanismos de atención para asignar diferentes pesos a cada parte del input, lo que permite enfocarse en las secciones más relevantes del texto.

Los tokens, por otro lado, son las unidades básicas de texto que los LLM procesan. Un token puede ser una palabra, un carácter o incluso una subpalabra. El uso eficiente de tokens permite a los modelos manejar texto de manera granular y detallada, optimizando la comprensión y la generación de lenguaje. Esta segmentación en tokens facilita que los modelos trabajen con diferentes idiomas y estilos de escritura, incrementando su flexibilidad y precisión en la generación de respuestas contextualmente relevantes.

En modelos avanzados como GPT y Mistral, la tokenización es crucial para manejar eficientemente las tareas de comprensión y generación de texto, permitiendo un procesamiento paralelo que mejora significativamente la eficiencia y la velocidad de respuesta.

Por qué tienen alucinaciones

Las alucinaciones en los LLM ocurren cuando el modelo genera información incorrecta o ficticia que no está respaldada por los datos de entrenamiento. Esto puede deberse a varias razones, como la interpretación incorrecta de contextos ambiguos o la extrapolación de patrones aprendidos de manera inapropiada. Aunque los LLM son muy avanzados, todavía no comprenden el mundo como lo hacen los humanos y, por lo tanto, pueden producir resultados que parecen plausibles pero que son erróneos.

Mitigar las alucinaciones es un desafío continuo que requiere mejoras en el diseño del modelo y en las técnicas de entrenamiento. Los investigadores están explorando enfoques como la incorporación de feedback humano en el ciclo de entrenamiento y el uso de modelos de verificación adicionales para validar la precisión de las respuestas generadas. Además, estrategias como el reinforcement learning con retroalimentación humana (RLHF) están siendo implementadas en modelos de lenguaje como Claude y Gemini para minimizar estas alucinaciones y mejorar la fiabilidad de las respuestas generadas.

Entrenamiento y aprendizaje en LLM

El entrenamiento de los LLM implica dos fases principales:

- Preentrenamiento: En esta fase, el modelo se expone a grandes volúmenes de texto para aprender patrones lingüísticos generales. Este proceso permite que el modelo desarrolle una comprensión básica del lenguaje.

- Ajuste fino (fine-tuning): En esta otra fase, el modelo se especializa en tareas específicas mediante el entrenamiento con datos etiquetados más específicos.

Esta combinación de técnicas permite a los LLM ser altamente precisos y versátiles en una amplia gama de aplicaciones, desde la traducción automática hasta la generación de contenido. En modelos como GPT y Claude el preentrenamiento masivo es seguido por un ajuste fino en dominios específicos para optimizar el rendimiento en tareas concretas. Además, el uso de técnicas de aprendizaje profundo (Deep Learning) como el aprendizaje supervisado y no supervisado, junto con la integración de optimizadores avanzados como Adam, mejora la eficiencia del proceso de entrenamiento y permite la adaptación de los modelos a nuevos contextos y necesidades.

Modelos de lenguaje preentrenados vs. personalizados

Los modelos de lenguaje preentrenados son aquellos que se han entrenado exhaustivamente con grandes cantidades de datos y están listos para ser utilizados en una variedad de aplicaciones sin necesidad de modificaciones adicionales. Estos modelos han desarrollado una comprensión general del lenguaje natural a partir del preentrenamiento masivo, lo que les permite abordar una amplia gama de tareas lingüísticas de manera eficiente desde el inicio.

Por otro lado, los modelos personalizados se adaptan específicamente a necesidades particulares mediante un proceso adicional conocido como ajuste fino. Durante el ajuste fino, el modelo se adapta a datos específicos y etiquetados relevantes para una tarea o dominio particular. Este proceso permite al modelo mejorar su capacidad para generar respuestas precisas y contextualmente relevantes en aplicaciones especializadas como medicina, finanzas o atención al cliente, superando así las capacidades de los modelos preentrenados en términos de relevancia y especificidad del dominio de aplicación. Adaptar la arquitectura y los parámetros del modelo durante este proceso optimiza su rendimiento, permitiéndole adquirir habilidades especializadas y generar resultados de alta calidad en contextos aplicativos específicos.

Desafíos éticos de los LLM

El uso de LLM plantea varios desafíos éticos significativos como la propagación de sesgos presentes en los datos de entrenamiento, la generación de información engañosa o perjudicial y las preocupaciones sobre la privacidad de los datos.

Además, la capacidad de estos modelos para producir texto realista plantea riesgos en términos de desinformación y suplantación de identidad. Abordar estos desafíos requiere una combinación de enfoques técnicos y regulaciones éticas, así como un enfoque en la transparencia y la responsabilidad en el desarrollo y el despliegue de estos modelos.

La implementación de auditorías algorítmicas y la creación de sistemas de IA explicativa pueden ayudar a mitigar estos riesgos, buscando equilibrar la potencia de la IA generativa con la necesidad de prácticas responsables y éticas.

Limitaciones de los LLM

A pesar de sus capacidades avanzadas, los LLM tienen limitaciones inherentes. Uno de los principales desafíos es su dependencia de grandes cantidades de datos y recursos computacionales, lo que puede hacer que su entrenamiento y operación sean costosos y lentos.

Los LLM a menudo carecen de una comprensión profunda y contextual del mundo, lo que puede llevar a errores en la generación de texto y a alucinaciones. También pueden reproducir sesgos presentes en los datos de entrenamiento, lo que puede perpetuar estereotipos y desigualdades. Estas limitaciones subrayan la necesidad de un desarrollo continuo y de enfoques complementarios para mejorar el rendimiento y la fiabilidad de los LLM.

La investigación en modelos de lenguaje más eficientes y en técnicas de reducción de sesgos busca superar estas barreras, intentando equilibrar la escalabilidad y la precisión con la sostenibilidad y la equidad.

Principales Modelos de Lenguaje

En el ámbito de los Modelos de Lenguaje de Gran Tamaño (LLM), varios modelos destacan por sus contribuciones significativas en el campo de la inteligencia artificial generativa. Estos modelos han sido pioneros en avanzadas técnicas de procesamiento del lenguaje natural, cada uno con características y aplicaciones distintas que los posicionan como referentes en la industria. Entre los más prominentes se encuentran:

GPT

El Generative Pre-trained Transformer, o GPT, un avance significativo en inteligencia artificial y desarrollado por OpenAI, es la última iteración de una serie aclamada de modelos de lenguaje basados en transformers, reconocidos por su capacidad para generar texto coherente y contextualmente relevante en una amplia variedad de tareas. Con miles de millones de parámetros, su potencia computacional y complejidad del modelo mejoran no solo la comprensión y generación de texto, sino también su desempeño en tareas complejas como resúmenes, traducciones y respuestas a preguntas, con mayor precisión y sofisticación.

Claude

Claude, el Modelo de Lenguaje (LLM) desarrollado por Anthropic, es diseñado con el objetivo de alcanzar un nivel humano en la comprensión y generación del lenguaje. Lo que distingue a Claude es su enfoque único en la modelización del lenguaje, que prioriza la comprensión contextual y el razonamiento. Su robustez y adaptabilidad lo hacen adecuado para una variedad de aplicaciones, desde asistentes virtuales y chatbots hasta generación de contenido y traducción de lenguaje. Además, su capacidad para aprender de las interacciones con los usuarios y mejorar continuamente su rendimiento potencia aún más su utilidad y efectividad.

Mistral

Mistral AI, desarrollado por ex investigadores de Meta y Google DeepMind, representa una alternativa europea significativa en comparación con OpenAI en la tecnología de IA, especialmente en el ámbito del procesamiento del lenguaje natural (NLP). La naturaleza de código abierto de sus modelos proporciona una mayor autonomía y accesibilidad para los desarrolladores externos, estableciéndolos estratégicamente como fundamentales para el desarrollo de chatbots, motores de búsqueda y diversas plataformas de IA. Sus capacidades multimodales permiten el procesamiento y la generación de texto junto con otros medios como imágenes y audio, lo que amplía aún más su utilidad y aplicabilidad en diversos escenarios tecnológicos.

Gemini

Gemini, es el modelo lingüístico revolucionario desarrollado por Google que ha generado gran interés en el campo del procesamiento del lenguaje natural (NLP) desde su introducción. Equipado con capacidades multimodales, puede integrar y procesar diferentes tipos de entrada, como texto, imágenes y audio, permitiendo experiencias conversacionales más inmersivas e interactivas. Este enfoque multimodal abre nuevas posibilidades para aplicaciones que van desde asistentes virtuales y bots de servicio al cliente hasta herramientas de creación de contenido y plataformas educativas.

Los Modelos de Lenguaje (LLM) representan una revolución en la inteligencia artificial, redefiniendo la interacción humano-máquina y el procesamiento de información a escala global. Desde GPT hasta Gemini, pasando por Claude y Mistral, cada uno de estos modelos aportan capacidades únicas que prometen transformar diferentes sectores. Con el potencial de mejorar nuestra vida diaria a través de asistentes virtuales más intuitivos, contenido generado de manera más dinámica y servicios al cliente más personalizados, los LLM nos invitan a explorar nuevos horizontes de innovación tecnológica y a abrazar el futuro de la comunicación humana potenciada por la IA.