IA Generativa en ciberseguridad: retos y estrategias en 2025

11/09/2025

En un contexto donde los ciberataques se sofistican a la misma velocidad que la tecnología, la inteligencia artificial generativa representa una fuerza ambivalente: por un lado, amplifica las capacidades defensivas, y por otro, redefine el alcance de las amenazas.

En 2025, la IA en ciberseguridad se ha convertido en una necesidad operativa para los altos ejecutivos de empresas orientadas a la gestión de clientes, como los que operan en sectores BPO, telecomunicaciones o banca. Este artículo plantea una radiografía de los retos más inmediatos y las estrategias más eficaces para mitigar riesgos reales con un enfoque data-driven.

¿Qué es la IA Generativa y cómo impacta en la ciberseguridad?

En 2025, la inteligencia artificial generativa deja de ser un concepto emergente para convertirse en un elemento estructural de la arquitectura de ciberseguridad empresarial. Su capacidad para crear contenido nuevo la hace doblemente poderosa: puede utilizarse tanto para reforzar los sistemas defensivos como para diseñar ataques más sofisticados y automatizados.

Para los equipos de dirección, esto plantea un cambio de enfoque: ya no basta con ver la ciberseguridad como un «coste operativo», sino como un pilar transversal que protege activos clave, como los datos de clientes, la infraestructura digital y la reputación de la marca. Las empresas que sepan incorporar IA generativa como parte activa de sus sistemas defensivos estarán mejor preparadas no solo para responder, sino para anticiparse a las amenazas y optimizar recursos.

Cómo la IA generativa afecta la seguridad digital

La IA generativa no se limita a crear textos o imágenes. En el ámbito de la ciberseguridad, puede generar código malicioso, simular voces, clonar identidades digitales o vulnerar sistemas automatizados. Para un Director de Seguridad de una empresa, esto implica una reconfiguración completa de los protocolos de detección y respuesta, ya que las amenazas ahora pueden ser completamente nuevas, no documentadas y específicas para cada entorno.

Según el estudio “Global Security Operations Center Study” de Morning Consult e IBM, aproximadamente un tercio del tiempo de los analistas de SOC se dedica a manejar alertas que no representan amenazas reales. Además, alrededor del 63 % de las alertas diarias son falsos positivos o de baja prioridad, lo que genera fatiga operativa, ralentiza la respuesta frente a incidentes críticos y reduce la eficiencia del tiempo medio de resolución.

Ante este escenario, la IA generativa puede jugar un papel dual: automatizando la priorización de alertas según su impacto en negocio o, si cae en manos equivocadas, aumentando la complejidad de los ataques que saturan los centros de operaciones de seguridad (SOC). Para los ejecutivos, la decisión ya no es si adoptar o no la IA, sino cómo integrarla estratégicamente para proteger la continuidad operativa y reducir el coste por incidente.

Ejemplos de amenazas de ciberseguridad con IA

En un entorno donde la IA puede diseñar ataques específicos para cada empresa, es clave comprender las formas más sofisticadas de amenazas emergentes que el Director de Seguridad de una empresa debe anticipar desde una perspectiva de negocio.

- Phishing hiperpersonalizado: uso de IA para generar correos de spear phishing que imitan patrones lingüísticos del remitente real, aumentando la tasa de conversión de ataques.

- Deepfakes en procesos de onboarding o verificación de identidad: creación de audios o vídeos falsos para eludir controles biométricos o de autenticación.

- Generación automática de malware adaptativo: el código malicioso se modifica dinámicamente para evadir sistemas de detección estáticos.

Más allá del aspecto técnico, el verdadero impacto es financiero. Según el Cost of a Data Breach Report 2024 de IBM, el coste promedio global de una brecha de datos fue de 4,88 millones de dólares, con un aumento del 10 % respecto a 2023. Incluso un incidente menor puede impactar KPIs clave como el CLV, NPS o coste por contacto afectado si se considera el post‑brecha, la pérdida de clientes y las penalizaciones regulatorias.

Los retos del ransomware y la IA Generativa

El ransomware potenciado por IA es un evento financiero y reputacional crítico. Su impacto directo incluye interrupciones en las operaciones, degradación de los tiempos de respuesta en canales de atención y pérdida de confianza por parte de clientes y partners. En España, donde muchas empresas aún operan con sistemas heredados y procesos parcialmente digitalizados, la IA generativa representa un doble filo: los atacantes la utilizan para automatizar campañas de extorsión más personalizadas, pero también puede ser clave para detectar patrones de ataque antes de que se materialicen.

Inteligencia artificial y ransomware: un desafío creciente

El ransomware ha evolucionado desde simples cifrados masivos hasta ataques quirúrgicos alimentados por inteligencia artificial generativa. Hoy, los atacantes pueden usar IA para identificar puntos débiles con mayor precisión, generar mensajes de ingeniería social más creíbles y automatizar la propagación lateral dentro de redes corporativas complejas. Esta sofisticación reduce el tiempo de ataque y aumenta el daño potencial.

En sectores con una fuerte dependencia digital, como banca, telecomunicaciones o servicios públicos, los ciberataques con IA están afectando directamente al tiempo medio de recuperación (MTTR), al costo total por incidente y a indicadores de confianza como el Net Promoter Score (NPS). La realidad para los responsables de estrategia digital es que la IA ha disminuido la barrera de entrada para los ciberdelincuentes, mientras que eleva el listón de exigencia para las defensas corporativas. Hoy, el ransomware no se combate solo con firewalls, sino con capacidad de anticipación y automatización inteligente.

Prevención de ataques con IA en 2025

En 2025, la prevención efectiva no depende únicamente de tener sistemas robustos, sino de su capacidad para aprender, adaptarse y responder en tiempo real. Las organizaciones líderes están integrando IA generativa en sus centros de operaciones de seguridad (SOC) para identificar patrones anómalos antes de que se conviertan en amenazas activas.

Entre las prácticas emergentes destacan:

- Simulación de ataques con IA para entrenar defensas dinámicas en escenarios realistas.

- Automatización de respuestas frente a amenazas conocidas y patrones similares, con supervisión humana para la toma de decisiones críticas.

- Uso de datos sintéticos generados por IA para entrenar modelos sin comprometer información sensible.

El objetivo no es reemplazar al equipo humano, sino aumentar su eficacia. Además esto significa pasar de un enfoque reactivo a uno proactivo, donde la IA no solo detecta amenazas, sino que optimiza recursos, reduce el tiempo de exposición y minimiza el impacto financiero.

Estrategias de ciberseguridad con Inteligencia Artificial

A medida que las amenazas impulsadas por IA se vuelven más específicas, las defensas tradicionales quedan obsoletas. La respuesta no está en más reglas estáticas, sino en sistemas adaptativos que aprenden, predicen y actúan con agilidad. Esta transformación exige repensar la gestión del riesgo digital y la eficiencia operativa como elementos centrales del negocio, integrándolos sin fricción en los procesos clave.

Estrategias avanzadas para combatir amenazas con IA

Para los responsables de tecnología y operaciones, la clave no está en sumar capas de defensa, sino en orquestar capacidades de inteligencia que prioricen lo importante y automaticen lo repetitivo. Algunas estrategias avanzadas que están demostrando impacto real en KPIs como el MTTR, el número de incidentes críticos y el coste por detección son:

- Análisis conductual avanzado con modelos de IA: permite detectar ataques no documentados basándose en desviaciones de comportamiento.

- Respuesta automatizada según nivel de criticidad: reducción de tiempos de contención sin intervención humana en eventos de bajo riesgo.

- Modelos generativos para threat hunting: creación de simulaciones de amenazas basadas en datos históricos y patrones emergentes, anticipando vectores de ataque.

Estas estrategias no eliminan el riesgo, pero sí reducen el margen de error humano y mejoran la resiliencia operativa. En sectores con alta exposición digital, esto puede marcar la diferencia entre continuidad de negocio o colapso operativo durante un ataque.

Herramientas de IA generativa para mejorar la seguridad

Para los responsables de tecnología y operaciones, la clave no está en sumar capas de defensa, sino en orquestar capacidades de inteligencia que prioricen lo importante y automaticen lo repetitivo. Algunas estrategias avanzadas que están demostrando impacto real en KPIs como el MTTR, el número de incidentes críticos y el coste por detección son:

- Análisis conductual avanzado con modelos de IA: permite detectar ataques no documentados basándose en desviaciones de comportamiento.

- Respuesta automatizada según nivel de criticidad: reducción de tiempos de contención sin intervención humana en eventos de bajo riesgo.

- Modelos generativos para threat hunting: creación de simulaciones de amenazas basadas en datos históricos y patrones emergentes, anticipando vectores de ataque.

Estas estrategias no eliminan el riesgo, pero sí reducen el margen de error humano y mejoran la resiliencia operativa. En sectores con alta exposición digital, esto puede marcar la diferencia entre continuidad de negocio o colapso operativo durante un ataque.

Ciberseguridad en atención al cliente: IA Generativa como aliada y riesgo

La IA generativa no solo transforma la forma en que las organizaciones responden a las amenazas, sino también cómo gestionan las interacciones con los clientes. En el entorno de los contact centers, donde convergen millones de datos sensibles y decisiones en tiempo real, la IA puede ser tanto un blindaje como una brecha. El reto para los responsables de experiencia de cliente y postventa es extraer valor de estas tecnologías sin poner en riesgo la confianza, el cumplimiento normativo, ni la integridad de los canales.

Cómo la IA generativa mejora la detección de fraudes en interacciones con clientes

Los intentos de fraude en canales de atención se han vuelto más sofisticados. La IA generativa, bien implementada, permite a las organizaciones identificar patrones anómalos de conversación, detectar cambios sutiles en la entonación o en la forma en que se solicita cierta información, e incluso generar alertas automatizadas ante interacciones de riesgo.

En 2025, los centros de contacto avanzados están empleando modelos generativos para:

- Analizar interacciones en múltiples idiomas y canales en tiempo real.

- Evaluar la autenticidad de las respuestas mediante lenguaje natural.

- Reforzar los procesos de verificación biométrica y contextual.

Esto no solo eleva la precisión de los sistemas antifraude, sino que reduce los falsos positivos, mejora la experiencia del cliente legítimo y disminuye los costes por verificación fallida, un KPI crítico en operaciones con alto volumen de llamadas.

Estrategias para proteger los datos sensibles de los clientes con IA

En un ecosistema donde los datos del cliente son un activo estratégico, protegerlos ya no es opcional: es una condición para competir. A medida que aumentan las expectativas regulatorias y los riesgos asociados al uso de IA generativa, se vuelve clave contar con soluciones que integren, por diseño, mecanismos avanzados de seguridad, trazabilidad y cumplimiento normativo.

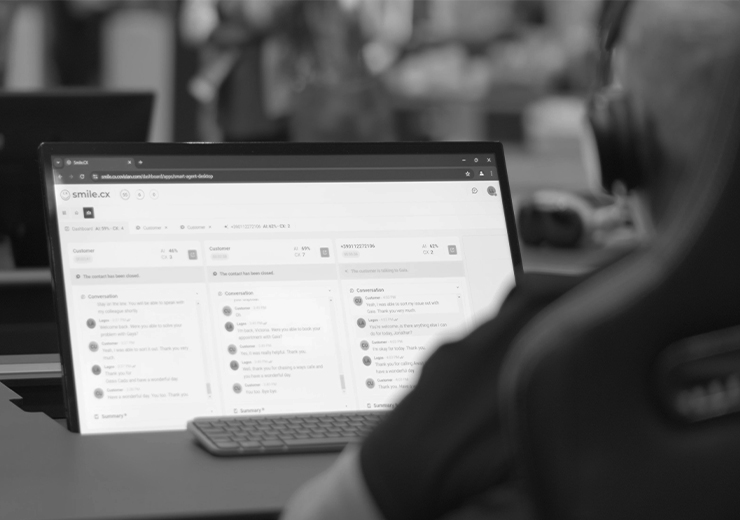

Smile.CX, plataforma CCaaS especializada en gestión de la atención al cliente, responde a esta necesidad con una arquitectura de seguridad alineada con los más altos estándares del mercado, adecuada para empresas de cualquier sector. En contextos especialmente sensibles donde la protección del dato es crítica para evitar sanciones y pérdida de confianza, como finanzas y seguros, este tipo de garantías no son un plus, sino un requisito indispensable dentro de los criterios de selección tecnológica.

Entre sus pilares clave:

- Cifrado avanzado conforme a normativas bancarias.

- Gestión de accesos basada en roles, que limita la exposición innecesaria de información sensible.

- Trazabilidad total de datos, compatible con marcos regulatorios como el RGPD y las políticas internas de cada organización.

Además, Smile.CX se apoya en una infraestructura certificada, monitorización continua en tiempo real y un enfoque proactivo hacia el cumplimiento, lo que permite a las empresas mantener el control sin fricción operativa. El impacto en los KPIs es claro:

- Reducción de riesgos operativos y reputacionales.

- Mayor velocidad y eficiencia en auditorías y controles de compliance.

- Escalabilidad segura en procesos de atención al cliente de alta complejidad.

Para los responsables de atención al cliente y tecnología, Smile.CX no es solo una plataforma, sino una capa de protección inteligente que asegura continuidad, confianza y escalabilidad, incluso en entornos altamente regulados.

Tendencias futuras en ciberseguridad e IA Generativa

En 2025, la ciberseguridad no solo protege: define qué empresas están preparadas para escalar sin exponerse. Frente a una IA generativa cada vez más integrada en procesos tanto defensivos como ofensivos, los líderes tecnológicos deben anticipar un cambio de paradigma, ya que las decisiones que hoy se tomen en materia de seguridad marcarán la capacidad de adaptación en los próximos años.

Innovaciones en inteligencia artificial para la ciberseguridad

Las principales innovaciones no están solo en las tecnologías, sino en cómo se aplican para reducir riesgo y aumentar capacidad de respuesta. En 2025 y los próximos años, veremos una adopción acelerada de:

- Modelos de IA multimodal para detección de anomalías: capaces de correlacionar texto, voz, comportamiento y patrones de acceso para identificar fraudes invisibles a los sistemas actuales.

- Automatización de decisiones en tiempo real: flujos de respuesta automática ante incidentes, integrados en sistemas de ticketing o CRMs, para reducir el tiempo medio de resolución (MTTR).

- IA explicable aplicada a compliance: Según el Stanford AI Index 2023, más del 65 % de las organizaciones señala la falta de aplicabilidad como la principal barrera para adoptar IA. Por eso, las auditorías asistidas por IA que explican causas y sugieren acciones correctivas son clave para garantizar transparencia y cumplimiento en sectores regulados como finanzas, salud y telecomunicaciones.

Innovaciones que no solo fortalecen la seguridad, sino que permiten ahorros tangibles en tiempo, coste operativo y exposición al riesgo reputacional.

Cómo prepararse para los desafíos de la IA en 2026

Prepararse para lo que viene no significa adoptar toda nueva tecnología, sino crear una arquitectura de decisiones capaz de adaptarse rápidamente a cambios regulatorios, amenazas emergentes y expectativas del cliente. Para los equipos directivos, esto se traduce en:

- Invertir en talento híbrido: expertos en ciberseguridad con comprensión del negocio y de la IA generativa.

- Incorporar métricas de seguridad al core del negocio: desde el coste por incidente hasta el impacto en el CLV (Customer Lifetime Value).

- Priorizar plataformas interoperables y seguras por diseño: que faciliten integraciones ágiles sin aumentar la superficie de ataque.

- Establecer un comité interno de ética y riesgo en IA: especialmente relevante en sectores regulados como banca, seguros y salud.

La ventaja no estará en tener más IA, sino en usarla con inteligencia, de manera responsable y visión de negocio.

¿Gestionas datos sensibles en canales de atención al cliente?

Descubre cómo Smile.CX protege cada interacción con una arquitectura de seguridad avanzada, trazabilidad total del dato y cumplimiento normativo integrado. Completa nuestro formulario de contacto y conoce cómo asegurar tus operaciones sin comprometer la experiencia del cliente.