¿Qué son los modelos de lenguaje grandes multimodales (MLLMs) y cómo están revolucionando la IA?

01/08/2024

En la última década, la inteligencia artificial ha experimentado avances significativos, y uno de los desarrollos más fascinantes es el surgimiento de los modelos de lenguaje grandes multimodales (MLLMs). En este artículo, exploraremos qué son los MLLMs, cómo funcionan y de qué manera están revolucionando el panorama de la IA, desde la traducción automática hasta la creación de contenido creativo y la mejora de interfaces de usuario.

Qué son los LLMs multimodales

En el mundo de la inteligencia artificial, los modelos de lenguaje grandes multimodales (MLLMs, por sus siglas en inglés) representan un avance significativo. Estos modelos no se limitan a procesar texto, sino que pueden integrar y comprender múltiples tipos de datos como imágenes, audio y video. Esto los convierte en herramientas poderosas para una amplia variedad de aplicaciones, desde la atención al cliente hasta la medicina y el marketing.

A diferencia de los modelos de lenguaje tradicionales, que solo manejan texto, los MLLMs tienen la capacidad de interpretar y generar contenido basado en diversos formatos de datos. Esto les permite proporcionar respuestas más precisas y contextualizadas, mejorar la interacción con los usuarios y ofrecer soluciones más eficientes y efectivas en diferentes sectores.

Conceptos básicos

Los MLLMs se basan en la arquitectura de los modelos de lenguaje grandes (LLMs) tradicionales, pero se amplían para manejar múltiples tipos de datos. Estos modelos utilizan redes neuronales avanzadas y técnicas de aprendizaje profundo para procesar y relacionar texto, imágenes, audio y otros tipos de información. Gracias a esta capacidad, pueden comprender el contexto de manera más completa y generar respuestas que integren información de diferentes fuentes.

Por ejemplo, un MLLM puede analizar una imagen y generar una descripción textual precisa, o interpretar una conversación en audio y responder de manera contextual. Esto se logra mediante el entrenamiento en grandes volúmenes de datos heterogéneos, lo que permite a los modelos aprender las relaciones y contextos entre diferentes tipos de datos.

Funcionamiento

El funcionamiento de los MLLMs se basa en una arquitectura compleja que combina múltiples tipos de redes neuronales y técnicas de aprendizaje profundo. Estos modelos se entrenan utilizando datos de texto, imágenes y audio, lo que les permite aprender a relacionar y contextualizar información de diferentes fuentes.

Arquitectura y entrenamiento en texto, imagen y audio

La arquitectura de los MLLMs incluye componentes especializados para procesar cada tipo de dato. Por ejemplo, pueden utilizar redes convolucionales para interpretar imágenes, redes recurrentes para procesar texto y modelos de procesamiento de audio para interpretar sonidos. Estos componentes se integran en una arquitectura unificada que permite al modelo procesar y relacionar diferentes tipos de datos de manera coherente.

El entrenamiento de los MLLMs implica la utilización de grandes volúmenes de datos heterogéneos. Durante el proceso de entrenamiento, el modelo aprende a identificar patrones y relaciones entre diferentes tipos de datos. Por ejemplo, puede aprender a generar descripciones textuales de imágenes o a interpretar conversaciones en audio y responder de manera contextual. Este proceso de entrenamiento permite a los MLLMs ofrecer respuestas más precisas y contextualizadas.

Aplicaciones prácticas

Los MLLMs tienen una amplia variedad de aplicaciones prácticas en diferentes sectores. Gracias a su capacidad de integrar y procesar múltiples tipos de datos, pueden ofrecer soluciones más efectivas y eficientes en diversos contextos.

Descubre los diferentes tipos de IA Generativa según el output obtenido.

En atención al cliente

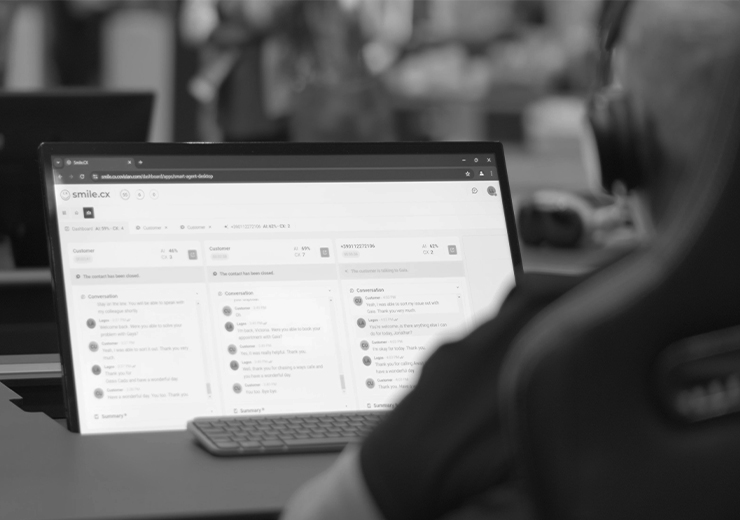

En el sector de atención al cliente, los MLLMs pueden transformar la experiencia del usuario. Al combinar texto, imágenes y audio, estos modelos pueden ofrecer soporte más preciso y contextual. Por ejemplo, pueden interpretar una captura de pantalla enviada por un cliente y proporcionar instrucciones detalladas sobre cómo resolver un problema específico. Además, pueden analizar conversaciones en tiempo real y ofrecer respuestas más precisas y relevantes.

También sirven como asistente de alta eficiencia al agente. Incluso incorporando tecnología de Realidad Virtual y Realidad Mixta, este tipo de modelos pueden no solo ayudar al agente con las tareas de menor valor, mientras éste atiende con empatía e inteligencia humana al cliente, sino que también ofrecen todo un nuevo espectro de realidad.

Smile.CX PRO XR es la herramienta única en el mercado que mediante el uso de gráficos tridimensionales inmersivos, los usuarios pueden explorar los KPI y clasificar los datos por país, sitios, equipos, operadores y llamadas, proporcionando una comprensión profunda y detallada del rendimiento a todos los niveles de la organización.

Conoce más sobre nuestros productos con capacidades multimodales.

En la salud

En el ámbito de la salud, los MLLMs pueden mejorar el diagnóstico y tratamiento de enfermedades. Pueden analizar imágenes médicas, como radiografías y resonancias magnéticas, junto con historiales médicos en texto para ofrecer diagnósticos más precisos y recomendaciones de tratamiento personalizadas. Además, pueden interpretar conversaciones entre médicos y pacientes, proporcionando sugerencias y alertas en tiempo real.

En marketing y publicidad

Para el marketing y la publicidad, los MLLMs ofrecen la capacidad de crear campañas más efectivas y personalizadas. Pueden analizar el comportamiento del consumidor a través de múltiples canales, incluyendo texto de redes sociales, imágenes publicitarias y videos promocionales, para diseñar estrategias de marketing más impactantes y dirigidas. Esto permite a las empresas mejorar la efectividad de sus campañas y aumentar la satisfacción del cliente.

Tres MLLMs del mercado

En el mercado actual, existen varios modelos de lenguaje grandes multimodales destacados que están revolucionando diferentes sectores.

- ChatGPT: Un modelo avanzado de lenguaje desarrollado por OpenAI que integra capacidades multimodales para ofrecer respuestas contextuales y precisas en diferentes aplicaciones.

- Gemini: Un modelo conocido por su capacidad de interpretar y generar contenido basado en texto, imágenes y audio, utilizado en diversas industrias para mejorar la eficiencia y efectividad.

- Vulcan: Un MLLM diseñado para aplicaciones empresariales, con un énfasis en la integración de datos multimodales para soluciones corporativas, mejorando la toma de decisiones y la eficiencia operativa.

La integración de modelos de lenguaje grandes multimodales en la inteligencia artificial no solo transforma cómo las máquinas entienden y procesan la información, sino que también impulsa un cambio significativo en la forma en que las empresas y organizaciones interactúan con sus clientes y usuarios. Adoptar y adaptarse a estas tecnologías es crucial para mantenerse a la vanguardia en un mundo cada vez más digital e interconectado.